Permanente link

Naar de actuele versie van de regeling

https://lokaleregelgeving.overheid.nl/CVDR760013

Naar de door u bekeken versie

https://lokaleregelgeving.overheid.nl/CVDR760013/1

Artificiële Intelligentie (AI) beleid gemeente Súdwest-Fryslân

Geldend van 03-04-2026 t/m heden

Intitulé

Artificiële Intelligentie (AI) beleid gemeente Súdwest-FryslânHet college van burgemeester en wethouders van de gemeente Súdwest-Fryslân;

gelet op de Verordening artificiële intelligentie en artikel 4:81 van de Algemene wet bestuursrecht;

besluit

vast te stellen het

Artificiële Intelligentie (AI) beleid gemeente Súdwest-Fryslân

Woord vooraf

Een algoritme is een formule om een bepaald doel te bereiken. Geavanceerde zelflerende algoritmes vallen onder artificiële intelligentie (AI), ook wel kunstmatige intelligentie genoemd. AI is sterk in ontwikkeling. Daardoor worden geavanceerde algoritmische beslismodellen steeds krachtiger en ingewikkelder. Er is een groeiend besef dat AI naast kansen ook risico’s met zich meebrengt. In Europa is daarom de AI Act vastgesteld die op 1 oktober 2024 van kracht geworden is. De AI Act moet ervoor zorgen dat AI betrouwbaar en veilig is, de kansen van AI worden benut en dat AI de grondrechten van de Europese Unie respecteert. Tegelijkertijd moet de wet innovatie ondersteunen en zorgen dat Europa blijft meetellen. Op dit moment zijn er nog geen tot heel weinig voorbeelden van hoe de inzet van AI goed te borgen bij gemeentes. Ook bij het Rijk ontbreekt dit nog grotendeels, de Algemene Rekenkamer maakt zich daarover zorgen.1 Zowel op Rijksniveau als op het niveau van gemeentes wordt hard gewerkt aan het opstellen van visies, beleid, richtlijnen, voorbeelden en praktische handleidingen. In maart 2025 heeft de VNG een Position paper2 en een Trendanalyse3 gepresenteerd die ondersteuning kunnen bieden voor het inregelen van verantwoorde inzet van AI. De projectgroep AI heeft het voor u liggende beleidsstuk opgesteld dat voor de gemeente Súdwest-Fryslân dient als eerste aanzet voor het slim, veilig en verantwoord kunnen inzetten van AI. Het beleid zorgt voor een uitwerking van de AI Act en geeft het kader waarbinnen de gemeente Súdwest-Fryslân met AI kan gaan werken.

Januari 2026

1. Inleiding

Kunstmatige intelligentie (AI) is niet nieuw. De toegankelijk- en toepasbaarheid is wel enorm vergroot de afgelopen jaren. Hoe gebouwen eruitzien, hoe mensen werk vinden, hoe vriendschappen en liefdes ontstaan, hoe allerlei activiteiten worden ondersteund van werk tot online winkelen; kunstmatige intelligentie, of het vaker gebruikte Engelse Artificial Intelligence (AI), gaat daar in de toekomst een steeds groter onderdeel van uitmaken. AI kan tevens een mooi hulpmiddel zijn in de ondersteuning van werkzaamheden bij de overheid. AI kan bij een gemeente bijvoorbeeld worden gebruikt voor verbetering of versnelling van gemeentelijke diensten. AI kan worden gebruikt in klantcontacten (chatbots), slimme steden (sensoren en voorspellende algoritmes), verkeersbeheer, energiebeheer en gegevensanalyse voor beleidsvorming. AI kan ook worden ingezet voor efficiëntie en kostenbesparing: automatisering van administratieve taken kan de werkdruk verlichten en de efficiëntie verhogen, wat mogelijk kan leiden tot kostenbesparing. Daarnaast kan AI bijdragen aan betere besluitvorming door gebruik van data en analyses. Tot slot biedt AI-mogelijkheden voor nieuwe dienstverlening en innovatie. Denk hierbij bijvoorbeeld aan het ontwikkelen van slimme oplossingen voor het beheer van stedelijke gebieden, zoals sensoren en Internet of Things (IoT) technologieën. De inzet van AI vraagt vanuit de gemeentelijke overheid om verschillende rollen.

Rollen om de positieve kansen van deze technologie benutten - voor inwoners, bedrijven en wetenschap. Én rollen om de grondrechten van allen actief te beschermen. Vrijheid en inclusie moeten gewaarborgd blijven.

Naast voordelen brengt AI namelijk ook uitdagingen en obstakels met zich mee. Wat is de betrouwbaarheid van AI en hoe controleer je die? Voor wie is AI toegankelijk en hoe weeg je wie toegang heeft tot de voordelen en wie de nadelen ondervindt? AI kan democratische waarden en gelijkheidsprincipes onder druk zetten. Een van de grootste uitdagingen bij het inzetten van AI is de noodzaak van privacy- en grondrechtenbescherming. Gemeentes moeten er immers voor zorgen dat de persoonsgegevens van burgers goed beschermd zijn en dat er voldaan wordt aan de privacywetgeving. Een ander mogelijk obstakel is de impact op de werkgelegenheid. Automatisering en AI kunnen leiden tot het vervallen van bepaalde functies en daarmee tot veranderingen in de organisatiecultuur en werkprocessen4. Maar AI zal ook voor nieuwe banen zorgen. Technologische vooruitgang heeft dat als gevolg. Bedenk maar eens dat meer dan 50% van alle functies en banen die nu bestaan, 40 jaar geleden niet bestond.

Daarnaast dient de impact op ons klimaat en leefomgeving worden meegenomen in de afweging bij het gebruik van AI. Het gebruik van natuurlijke hulpbronnen en de fysieke leefomgeving die nodig is voor het trainen en gebruiken van grote AI-modellen trekt een grote wissel op onze planeet. Het energieverbruik van het gebruik van AI is groot en daarom zorgelijk5. En dan is er nog de afhankelijkheid van Big Tech. De concentratie van macht ligt immers bij een klein aantal bedrijven en dat betekent dat zij steeds meer invloed hebben onze samenleving en het mogelijke verlies van kennis en kunde in de eigen organisatie. Dit laatste aspect raakt hoe er met werknemers, een organisatie en de samenleving omgaan. AI is merendeels geïmporteerd uit o.a. China, de Verenigde Staten en Rusland en daarmee gebaseerd op andere normen en waarden dan de Europese. Automatisering en AI kan leiden tot een gebrek aan menselijke interactie en onpersoonlijke dienstverlening. Daarnaast kunnen er ook fouten optreden als gevolg van automatisering, bijvoorbeeld als er verkeerde data wordt ingevoerd of data verkeerd wordt geïnterpreteerd door een algoritme. Bij het gebruik van AI is er ook een risico op bevooroordeelde beslissingen en discriminatie als gevolg van de data/regels die gebruikt worden om beslissingen te nemen. We zullen dus ook kritisch moeten zijn op deze technologie als mogelijke oplossing. Kortom de inzet van AI vraagt om het wegen van de kansen en mogelijkheden tegenover de uitdagingen en risico’s:

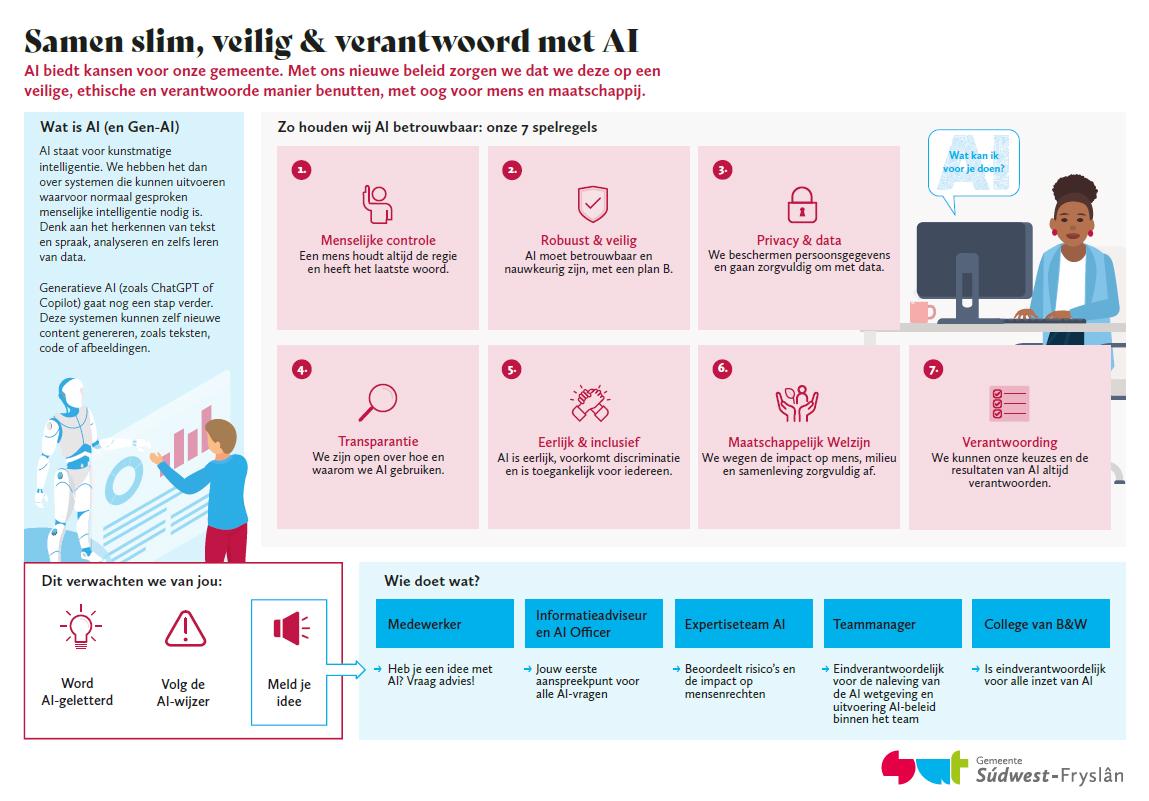

Met dit door het College vastgestelde AI beleid scheppen we een gedeelde grond, waarop we binnen de gemeente voortdurend samen kunnen bepalen welke richting we met AI op willen gaan en welke randvoorwaarden er zijn als we AI willen inzetten. Dit beleid helpt de gemeente op een verantwoorde manier met deze technologie om te gaan. Waar zetten we AI in en waar moeten we voor oppassen of zetten we geen AI in? Daarbij wordt aangesloten bij ontwikkelingen zoals de overheidsbrede visie op generatieve artificiële intelligentie (AI)6 Het implementatiekader van het Ministerie van Binnenlandse Zaken voor verantwoorde inzet van algoritmen7 de stukken van de VNG en landelijke en/of Europese wet- en regelgeving zoals de pas van kracht geworden AI-act.8

Het beleid voor kunstmatige intelligentie (AI) in de gemeente moet niet alleen aansluiten bij de nationale en Europese wetgeving, zoals de AI Act, maar ook rekening houden met lokale behoeften, ethische overwegingen, gevolgen voor de organisatie en de verantwoordelijkheid naar de inwoner. Het doel is om AI op een duurzame, transparante en verantwoordelijke manier in te zetten, waarbij zowel de voordelen voor de samenleving als mogelijke risico's goed worden beheerd.

2. AI: wat is het?

AI is de overkoepelende term voor alle technieken en methoden om machines taken te laten uitvoeren die menselijke intelligentie vereisen. Er zijn verschillende vormen van deze technologieën te onderscheiden: Algoritme, Kunstmatige Intelligentie, Machine Learning, Deep Learning en Large Language Models (LLMs). Hieronder worden deze verschillende vormen verder uitgelegd.

Wat zijn Algoritmen?

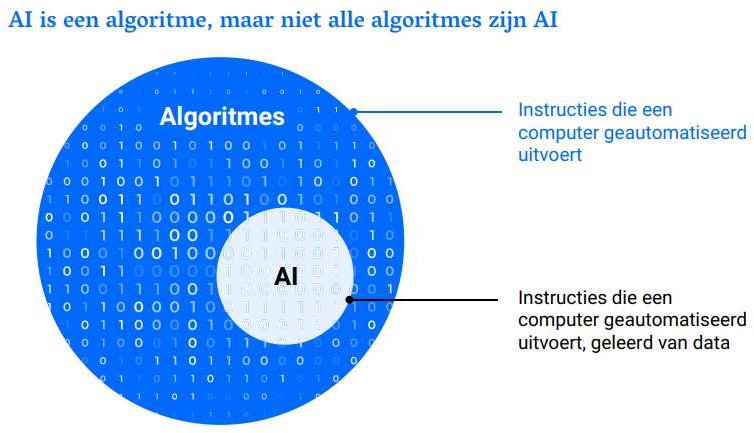

Een reeks instructies of regels om een taak te voltooien of een probleem op te lossen. Zelfs het bereiden van een maaltijd volgens een recept is bijvoorbeeld al een algoritme. Binnen de computerwetenschap vormen algoritmen de basis van alle soorten software, inclusief AI-systemen: ze worden gebruikt om gegevens te manipuleren, berekeningen te maken, of geautomatiseerde redeneringen uit te voeren. Definitie van de Algemene Rekenkamer9 “Een set van regels en instructies die een computer geautomatiseerd volgt bij het maken van berekeningen om een probleem op te lossen of een vraag te beantwoorden”.

Wat is Kunstmatige Intelligentie (AI)?

AI is de wetenschap die zich bezighoudt met systemen die taken kunnen uitvoeren die normaalgesproken menselijke intelligentie vereisen, zoals leren, redeneren, problemen oplossen, perceptie, en taalbegrip. AI kent heel veel toepassingsgebieden, van spraakherkenning en beeldanalyse tot autonome voertuigen en gepersonaliseerde aanbevelingssystemen.

Wat is Machine Learning?

Machine Learning is een tak van Kunstmatige Intelligentie en is gebaseerd op het idee dat systemen kunnen leren van data, dat ze patronen kunnen herkennen en dat ze beslissingen kunnen maken zonder tussenkomst van mensen. Machine Learning leunt sterk op statistische wetenschap.

Wat is Deep Learning?

Deep Learning is een onderdeel van Machine Learning, gebaseerd op meerdere lagen neurale netwerken. Het combineert de vooruitgang in rekenkracht en de speciale soorten neurale netwerken om gecompliceerde patronen in grote hoeveelheden data te leren herkennen. Deep Learning technieken worden bijvoorbeeld gebruikt om objecten in afbeeldingen en woorden in geluiden te kunnen herkennen.

Wat zijn Large Language Models (LLM’s)?

Dit is een specifiek type van Machine Learning, dat getraind wordt met grote hoeveelheden data en in staat is om menselijke taal te begrijpen en te genereren. LLM’s gebruiken Machine Learning technieken - met name Deep Learning - om patronen in gegevens te leren.

Voorbeelden zijn ChatGPT-4, CoPilot, Gemini en Google Bard die zijn getraind op grote hoeveelheden tekst van het internet en in staat zijn om menselijke taal te genereren.

Een algoritme is een set van instructies die een computer geautomatiseerd uitvoert. Door deze instructies uit te voeren kan een computer aanbevelingen doen of vragen beantwoorden. In veel gevallen worden de instructies van een algoritme expliciet door mensen ingebouwd. Bijvoorbeeld bij een beslisboom-algoritme dat de regels van de wet volgt om te bepalen of een persoon recht heeft op toeslag. Bij AI is dat anders. Daar worden de instructies automatisch geleerd uit data. De instructies die door mensen worden gegeven spelen een kleinere rol. Een AI-systeem kan bijvoorbeeld aan de hand van bestaande teksten leren nieuwe teksten te genereren. Hoe het AI- systeem teksten genereert is dan niet van tevoren bepaald. AI-systemen zijn algoritmes omdat ze automatisch instructies uitvoeren, maar niet alle algoritmes zijn AI. Er zijn namelijk ook algoritmes waarvan de instructies niet zijn geleerd uit data. In andere woorden, AI-systemen zijn datagedreven algoritmes.

3. Doelen van het beleid

Werken met AI binnen de overheid blijkt een uitdagende en interessante onderneming dat een gedegen AI beleid vereist om zowel effectief als verantwoord te zijn. Zonder een solide beleidskader kunnen er risico's ontstaan op het gebied van privacy, ethiek, burgerrechten en duurzaamheid.

AI beleid zorgt voor consistentie bij het gebruik van in te zetten AI. Het AI beleid gemeente Súdwest- Fryslân biedt de noodzakelijke randvoorwaarden en uitwerking om deze technologie slim, veilig, verantwoord, gemotiveerd en ethisch te implementeren. Het stelt de gemeente in staat om de voordelen van AI te benutten, zoals efficiëntie en innovatie, zonder concessies te doen aan de integriteit en het vertrouwen van de burger.

Waarom AI-beleid:

- •

Toename gebruik AI, steeds meer mogelijk met AI en AI-systemen worden steeds toegankelijker;

- •

AI beleid stelt de gemeente in staat om de kansen van AI te benutten, zoals het beter voorspellen van burgervragen en -behoeften, het verbeteren van processen en efficiency te bevorderen;

- •

AI beleid helpt bij de implementatie van de op 1 augustus 2024 van kracht geworden Europese AI- verordening;

- •

AI beleid ondersteunt het vinden van een balans tussen innovatie en verantwoord gebruik van AI;

- •

Het beschrijven van de ethische en maatschappelijke aspecten van AI helpt voor de bewustwording van gebruikers en om het vertrouwen te behouden bij de inwoners;

- •

Er moet worden voldaan aan specifieke eisen en normen voor de ontwikkeling;

- •

Het gebruik en de controle van AI en de transparantie en de ethische aspecten dienen gewaarborgd te worden;

- •

Eventuele risico’s dienen gemitigeerd te worden en verantwoordelijkheden en regelgeving worden zo vastgelegd.

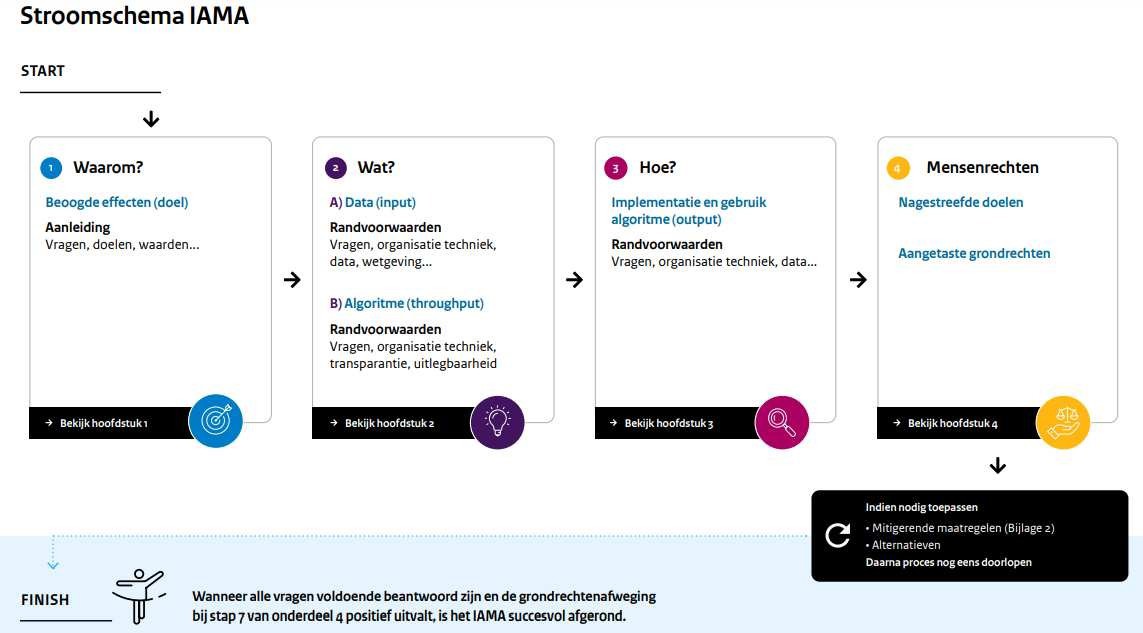

Naast dit beleid zijn een aantal operationele documenten opgesteld en wordt gebruik gemaakt van voorliggende kaders zoals de IAMA10 de Impactanalyse en het Algoritmeregister.11

4. Kaders

4.1 Het gebruik van AI valt onder de volgende wettelijke kaders:

4.1.1 De AI Act

De AI Act12 is een Europese verordening die regels stelt voor autonoom handelende computersystemen

en algoritmes die beslissingen nemen, content genereren of mensen assisteren. Het

doel is dat mensen en organisaties in de Europese Unie kunnen rekenen op veilige,

transparante, traceerbare, niet-discriminerende en milieuvriendelijke AI-systemen

onder menselijk toezicht. De verordening is op 1 augustus 2024 van kracht geworden,

doorloopt een aantal fases en zal op 2 augustus 2027 geheel van kracht zijn.

Het doel volgens de AI Act is:

“Artikel 1 lid 1. Deze verordening heeft tot doel de werking van de interne markt te verbeteren en de toepassing van mensgerichte en betrouwbare artificiële intelligentie (AI) te bevorderen, en tegelijkertijd een hoog niveau van bescherming van de gezondheid, de veiligheid en de in het Handvest verankerde grondrechten te waarborgen, met inbegrip van de democratie, de rechtsstaat en de bescherming van het milieu, tegen de schadelijke gevolgen van AI-systemen in de Unie, en innovatie te ondersteunen.”

De definitie van AI volgens de AI Act:

Artikel 3 lid 1: ““AI-systeem”: een op een machine gebaseerd systeem dat is ontworpen om met verschillende niveaus van autonomie te werken en dat na het inzetten ervan aanpassingsvermogen kan vertonen, en dat, voor expliciete of impliciete doelstellingen, uit de ontvangen input afleidt hoe output te genereren zoals voorspellingen, inhoud, aanbevelingen of beslissingen die van invloed kunnen zijn op fysieke of virtuele omgevingen;”

De AI Act van de Europese Unie vormt het juridische kader voor het gebruik van AI in geheel Europa. In de AI Act staan regels voor het verantwoord ontwikkelen en gebruiken van AI door bedrijven, overheden en andere organisaties met als doel om de veiligheid, gezondheid en fundamentele rechten van mensen te beschermen. Hierdoor kunnen organisaties erop vertrouwen dat de AI die zij gebruiken verantwoord is en kunnen ze optimaal profiteren van de kansen van AI.

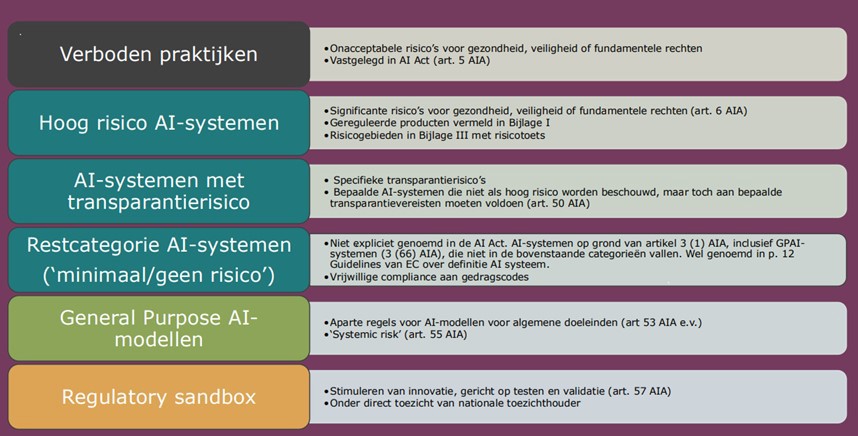

De AI Act volgt een risico-gebaseerde benadering en stelt verplichtingen voor aanbieders en gebruikers afhankelijk van het risiconiveau van een AI-systeem. De AI Act is van toepassing op alle sectoren, zoals gezondheidszorg, overheid, financiën, onderwijs en entertainment, met aangepaste regels voor opsporings- en veiligheidsdiensten. Afhankelijk van het AI-systeem of de context waarin het gebruikt gaat worden, gelden er andere eisen. Toepassingen van AI die echt ontoelaatbare risico’s opleveren voor mensen, zijn verboden. Denk daarbij aan systemen die worden gebruikt voor een oneerlijke beoordeling van mensen (zogenaamde ‘social scoring’). Aan AI met hoge risico’s, zoals bij toepassingen op de arbeidsmarkt of in de financiële dienstverlening, worden duidelijke eisen gesteld. Bij bepaalde AI-toepassingen die met burgers contact hebben (zoals chatbots) of content maken of manipuleren (deepfakes) moet het duidelijk zijn dat dit AI is (transparantie-risico). Aan AI-toepassingen die weinig of geen risico’s met zich meebrengen worden geen nieuwe eisen gesteld. De meeste AI-systemen die nu in Europa worden gebruikt, vallen nog in deze categorie.

Specifieke regels voor overheidsinstanties

De AI Act voorziet ook in aanvullende regels voor overheidsinstanties en entiteiten die openbare diensten verlenen. Deze moeten altijd een zogenaamde 'fundamental rights impact assessment' (FRIA en in het Nederlands: IAMA13) uitvoeren voor risicovolle systemen en vanaf 2 augustus 2026 hun inzet van risicovolle AI-systemen registreren in de Europese database voor risicovolle AI-systemen.

4.1.2 Algemene verordening gegevensbescherming (Avg)

De AI Act staat in nauwe relatie tot de Avg indien dit het gebruik van persoonsgegevens binnen of voor de AI betreft. Het kader van de Avg is niet geheel hetzelfde als dat van de AI Act: bijvoorbeeld hoog risico onder de Avg is niet hetzelfde als een hoog risico onder de AI Act. Er zijn echter ook duidelijke overeenkomsten met de verplichte uitvoering van Data Protection Impact Assessments (DPIA’s) uit de Avg en de voorgeschreven Fundamental Rights Impact Assessment (FRIA’s/IAMA) uit de AI Act. Uitvoeren van een DPIA is in de meeste gevallen verplicht als het gaat om AI-systemen volgens de Autoriteit Persoonsgegevens. Privacy by design (een belangrijk principe uit de Avg) in AI betekent dat privacybescherming wordt ingebouwd in de AI-systemen vanaf het allereerste stadium. Het uitvoeren van Data Protection Impact Assessments (DPIA's)14 om privacyrisico's te identificeren en te mitigeren, lijkt een praktisch middel om dit te implementeren. In de DPIA komen alle gegevensbeschermingsbeginselen aan bod en is er aandacht voor het belang om transparant te zijn over hoe gegevens worden verzameld, gebruikt en bewaard, en moet je nadenken over mogelijkheden om ervoor te zorgen dat mensen waarvan hun gegevens door middel van AI worden verwerkt controle hebben over hun eigen gegevens en de output van het AI-systeem. Daarbij is het noodzakelijk om AI-systemen te testen, testen en nog eens te testen en daarbij oog te hebben voor mogelijke verschillen in nadelige effecten voor verschillende doelgroepen, zoals minderheden. Op die manier kan discriminatie worden voorkomen en kunnen de rechten en vrijheden van individuen worden beschermd.

De European Data Protection Board (EDPB: Europese toezichthouder AI) heeft op 18 december 2024 een Richtlijn15 gepubliceerd over de inzet van AI en het verwerken van persoonsgegevens. In de Richtlijn legt de EDPB onder andere uit hoe organisaties en toezichthouders kunnen controleren of een AI-model anoniem is. Deze Richtlijn geeft een goed kader hoe te werken met AI

4.1.3 AI-act en andere wetgeving

Daarnaast raakt de AI Act de wetgeving rondom Intellectuele eigendom en auteursrecht, de Algemene wet bestuursrecht (Awb), de BIO (baseline Informatiebeveiliging Overheid)16 /NIS217 en de Grondwet.

Intellectuele eigendom: AI ontwikkelt zich steeds meer waardoor AI-systemen ook auteursrechtelijk beschermde werken kunnen en gaan kopiëren. Dit kan inbreuk maken op de rechten van auteurs en kunstenaars. Bovendien wordt het lastiger om de eigenaar van een bepaald werk te ontdekken. Auteursrecht verwijst naar de rechten die een auteur heeft over zijn werk. Dit omvat het exclusieve recht om het werk te reproduceren, te distribueren en openbaar te maken. Hetauteursrecht beschermt een breed scala aan creatieve werken, waaronder boeken, muziek, films en beeldende kunst. Vooral in de Verenigde Staten is hierover reeds veel debat en worden rechtszaken aangespannen.

Algemene wet bestuursrecht (Awb): Volgens het bestuursrecht moet de overheid aan een aantal beginselen van behoorlijk bestuur voldoen. De vraag is hoe daaraan te voldoen bij het gebruik van bijvoorbeeld algoritmische besluitvorming. Besluiten van de overheid moeten begrijpelijk zijn, op een begrijpelijke wijze tot stand zijn gekomen en de overheid moet kunnen uitleggen hoe het besluit is genomen. De burger moet vervolgens kunnen begrijpen waarom het besluit zo is uitgevallen.

BIO/NIS2 De implementatie van de Network and Information Security Directive (NIS2) is een belangrijke mijlpaal voor de cyberbeveiliging binnen de Europese Unie. Deze EU-brede regelgeving legt de nadruk op het versterken van de cyberweerbaarheid van organisaties, met een speciale focus op die welke essentiële diensten aanbieden. AI kan bijvoorbeeld helpen bij het detecteren van malware en ransomware in apparaten en netwerken. NIS2 vereist dat de gemeentelijke overheden voldoen aan specifieke beveiligingsnormen en incidenten rapporteert, waarbij AI kan bijdragen aan het versterken van de sector tegen cyberaanvallen.

Grondwet en grondrechten:

Voorbeelden van publieke waarden die zijn vertaald in grondrechten zijn gelijkwaardigheid (recht op non-discriminatie), respect voor persoonlijke autonomie, solidariteit, vrijheid, veiligheid, verantwoordelijkheid, duurzaamheid, rechtszekerheid, verdelende rechtvaardigheid, respect voor kwetsbare groepen, participatie en efficiënte besteding van middelen. Op een concreter niveau wordt de bescherming van democratische grondrechten (zoals vrijheid van meningsuiting, het recht op toegang tot informatie en het recht op een eerlijk proces) tot de publieke waarden gerekend. Algoritmen kunnen dienen om bepaalde publieke waarden te vertalen naar concrete besluitvorming. Daarbij kunnen algoritmen bepaalde waarden versterken, maar ze kunnen ook publieke waarden - zoals grondrechten - aantasten. Juist daarom is het belangrijk om in kaart te brengen welke publieke waarden aan de orde kunnen zijn bij de inzet van het algoritme en hoe hiermee om te gaan.

4.2 Normatief kader

Naast de wettelijke kaders zijn bij de inzet van algoritmes en AI de normatieve kaders van belang. Deze volgen hier:

4.2.1 Duurzaamheid en Maatschappelijke verantwoordelijkheid

AI is enorm bewerkelijk en kost dan ook veel energie.18 Dat geldt niet alleen voor het onttrekken van benodigde materialen aan de aarde voor het produceren van computers en datacentra. Ook voor het trainen van AI is veel energie nodig. Dat leidt tot veel CO2 uitstoot. Kunstmatige intelligentie draagt dan ook bij aan het versneld opwarmen van de aarde. De zeldzame en eindige hoeveelheid grondstoffen is inzet van internationaal conflict. Het ontginnen ervan schaadt bijvoorbeeld historische rechten van bewoners die moeten vertrekken om ontginning mogelijk te maken. Bovendien vervuilt en beschadigt de ontginning de natuurlijke omgeving en creëert het werkomstandigheden die in Europa als niet acceptabel worden geacht. De impact van AI op het klimaat moet daarom worden meegenomen in de afwegingen wanneer en hoe AI wordt gebruikt.

4.2.2 Ethiek en Mensenrechten

Ethiek moet centraal staan bij de keuze en toepassing van AI. Ethiek is geen losstaand onderdeel in het toetsen van algoritmes en AI. Bij het gebruik van AI-technologie is het van essentieel belang dat er ethische richtlijnen en principes in acht worden genomen. Deze richtlijnen dienen als leidraad om ervoor te zorgen dat AI op een verantwoorde manier wordt ingezet, rekening houdend met ethische dilemma’s die kunnen ontstaan.

Een van de belangrijkste ethische richtlijnen voor AI is het waarborgen van transparantie. Het is van cruciaal belang dat gebruikers inzicht hebben in hoe AI-systemen werken en welke data er worden gebruikt om beslissingen te nemen. Transparantie creëert vertrouwen en maakt het mogelijk om mogelijke vooringenomenheid en discriminatie te identificeren en aan te pakken.

Een andere ethische richtlijn is het waarborgen van privacy en gegevensbescherming. AI-systemen verwerken enorme hoeveelheden gegevens en het is belangrijk dat deze informatie veilig en vertrouwelijk wordt behandeld. Gebruikers moeten controle hebben over hun persoonlijke gegevens en de mogelijkheid hebben om toestemming te geven voor het gebruik ervan.

Het vermijden van discriminatie is ook een belangrijk ethisch principe bij het gebruik van AI. AI- systemen mogen geen beslissingen nemen op basis van factoren als ras, geslacht, leeftijd of andere beschermde kenmerken. Het is essentieel dat AI-systemen eerlijk en rechtvaardig zijn, en dat ze de bestaande ongelijkheden in de samenleving niet versterken.

Een ander ethisch dilemma dat kan ontstaan bij het gebruik van AI is de verantwoordelijkheid achter deze technologie. Wie is er verantwoordelijk wanneer een AI-beslissing negatieve gevolgen heeft?

Het is belangrijk om de verantwoordelijkheid en aansprakelijkheid duidelijk te definiëren en vast te leggen.

4.2.3 Werkgever-werknemer-relatie: AI en de gevolgen voor werknemers en de organisatie

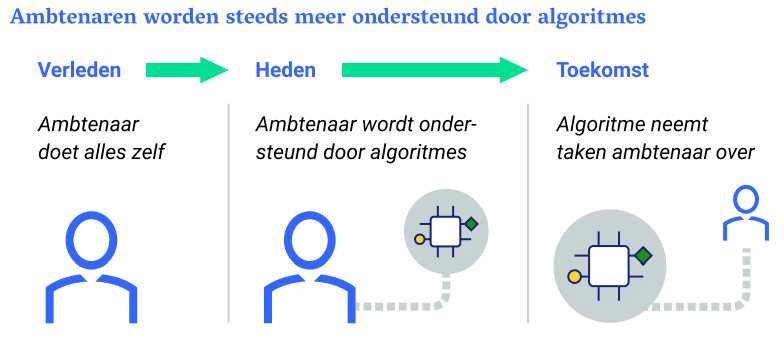

Het is denkbaar dat de ontwikkeling met het gebruik van AI als volgt zal zijn:

Het gebruik van AI is sowieso van invloed op de werknemers en de organisatie. Het is van belang deze ontwikkeling zorgvuldig te monitoren, erop te reflecteren en te begeleiden. De OR heeft een formele rol bij diverse digitale ontwikkelingen en zo ook op de inzet van AI als het gaat om organisatorische en/of personele gevolgen. Denk aan verschuiving/afstoting werkzaamheden/ het aanschaffen van AI-systemen/invoering AI-tools en de bescherming persoonsgegevens: artikelen 25 en 27 van de Wet op de Ondernemingsraden (WOR).

4.3 AI en burgers

Burgers moeten actief betrokken worden bij het proces van AI-toepassing en geïnformeerd worden over de manieren waarop AI hun leven beïnvloedt. De gemeente zou bijvoorbeeld een programma kunnen ontwikkelen om burgers te informeren en bewust te maken van AI-technologieën.

Bijvoorbeeld door middel van consultaties of gemeentelijke platforms. Dit AI beleid stelt dat er mechanismen moeten komen voor burgers om feedback te kunnen geven op het gebruik van AI binnen de gemeentelijke diensten. Dit kan bijvoorbeeld via een raadplegingsproces of door een onafhankelijke toezichthouder in te stellen, maar de uitwerking hiervan moet nog vormgegeven worden.

4.4 Principes

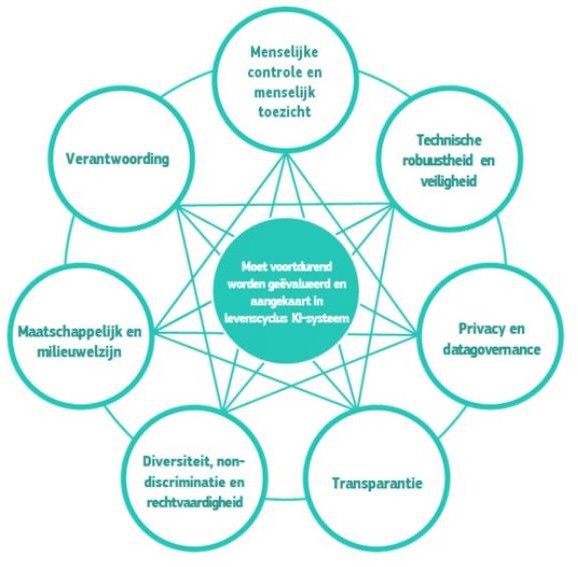

Het formuleren van principes zorgt voor ingekleurde randvoorwaarden bij de inzet van AI. De deskundigengroep van de Europese Unie heeft Ethische Richtsnoeren opgesteld voor de inzet van betrouwbare AI. Het doel van deze richtsnoeren is het bevorderen van betrouwbare AI. Betrouwbare AI bestaat uit drie componenten, waaraan gedurende de volledige levenscyclus van het systeem moet worden voldaan: de AI moet a) wettig zijn, door te voldoen aan alle toepasselijke wet- en regelgeving, b) ethisch zijn, door naleving van ethische beginselen en waarden te waarborgen, en c) robuust zijn uit zowel technisch als sociaal oogpunt, aangezien AI-systemen ongewild schade kunnen aanrichten, zelfs al zijn de bedoelingen goed. Iedere component is op zichzelf nodig, maar niet voldoende om betrouwbare AI te bewerkstelligen. In het ideale scenario sluiten alle drie de componenten op elkaar aan en valt de werking ervan gedeeltelijk samen. De uitwerking van de componenten krijgt vorm in 7 principes. Deze leidende principes zijn19.

Menselijke controle en toezicht: AI-systemen moeten mensen informeren, zodat ze weloverwogen beslissingen kunnen nemen en hun fundamentele rechten kunnen bevorderen. Tegelijkertijd moeten er goede toezichtmechanismen worden gewaarborgd, die kunnen worden bereikt via human-in-the-loop, human-on-the-loop en human-in-command- benaderingen.

Technische robuustheid en veiligheid: AI-systemen moeten veerkrachtig en veilig zijn. Ze moeten veilig zijn, een noodplan hebben voor het geval er iets misgaat, en ze moeten nauwkeurig, betrouwbaar en reproduceerbaar zijn. Dat is de enige manier om ervoor te zorgen dat ook onbedoelde schade kan worden geminimaliseerd en voorkomen.

Privacy en datagovernance: naast het waarborgen van volledige eerbiediging van de privacy en gegevensbescherming, moeten er ook adequate mechanismen voor datagovernance worden gewaarborgd, waarbij rekening wordt gehouden met de kwaliteit en integriteit van de gegevens en gelegitimeerde toegang tot de gegevens wordt gewaarborgd.

Transparantie: de data, het systeem en de AI-bedrijfsmodellen moeten transparant zijn. Traceerbaarheidsmechanismen kunnen helpen dit te bereiken. Bovendien moeten AI- systemen en hun beslissingen worden uitgelegd op een manier die is aangepast aan de betrokkene(n). Mensen moeten zich ervan bewust zijn dat ze interacteren met een AI-systeem en moeten op de hoogte zijn van de mogelijkheden en beperkingen van het systeem.

Diversiteit, non-discriminatie en eerlijkheid: oneerlijke vooroordelen moeten worden vermeden, omdat ze meerdere negatieve gevolgen kunnen hebben, van marginalisering van kwetsbare groepen tot verergering van vooroordelen en discriminatie. Om diversiteit te bevorderen, moeten AI-systemen toegankelijk zijn voor iedereen, ongeacht een beperking, en relevante belanghebbenden betrekken gedurende hun hele levenscyclus.

Maatschappelijk en ecologisch welzijn: AI-systemen moeten alle mensen ten goede komen, inclusief toekomstige generaties. Daarom moet ervoor worden gezorgd dat ze duurzaam en milieuvriendelijk zijn. Bovendien moeten ze rekening houden met het milieu, inclusief andere levende wezens, en hun sociale en maatschappelijke impact moet zorgvuldig worden overwogen.

Verantwoording: Er moeten mechanismen worden ingevoerd om verantwoordelijkheid en verantwoording voor AI-systemen en hun uitkomsten te garanderen. Controleerbaarheid, die de beoordeling van algoritmen, gegevens en ontwerpprocessen mogelijk maakt, speelt hierbij een sleutelrol, met name in kritieke toepassingen.

Bij de inzet van AI in de gemeente Súdwest-Fryslân vormen deze principes de basis en worden deze principes door het expertiseteam AI gewogen.

5. AI governance: organisatie, taken & verantwoordelijkheden

AI Governance richt zich op het creëren van een duidelijke rol- en taakverdeling en het waarborgen van verantwoordelijkheid in het AI-ecosysteem van een organisatie. Een goed ingerichte governance schept een omgeving waarin werknemers AI veilig kunnen inzetten voor het bevorderen van efficiëntie en innovatie. De AI Governance wordt als volgt ingericht:

|

Verantwoordelijk |

|

|

Feitelijk verantwoordelijk |

|

|

Eindverantwoordelijk |

|

|

Adviserend |

|

|

Geïnformeerd |

|

Gemeenteraad

De gemeenteraad is het hoogste bestuursorgaan in de gemeente. De gemeenteraad geeft aan wat er in een gemeente moet gebeuren en ziet toe op het werk van de burgemeester en wethouders. De gemeenteraad heeft de volgende rollen en verantwoordelijkheden:

- •

Vertegenwoordiging van het algemeen belang bij de inzet van AI.

- •

Kaderstellende rol.

- •

Controlerende rol.

College van B&W

Het College is eindverantwoordelijk voor de inzet van AI en de naleving van regelgeving binnen de gemeente. Het College heeft de volgende rollen en verantwoordelijkheden:

- •

Eindverantwoordelijk voor de inzet van AI.

- •

Eindverantwoordelijk voor naleving van de AI-wetgeving en kaders binnen de gemeente.

- •

Stelt het AI-beleid vast.

Directie

De directie zorgt dat alle inzet van AI altijd onder de verantwoordelijkheid valt van een teammanager, een directeur of de gemeentesecretaris. De directie zorgt dat deze zich verantwoorden over de inzet of andere informatie die onder hen berust over de inzet van AI. De Directie heeft de volgende rollen en verantwoordelijkheden:

- •

De directie autoriseert de benodigde richtlijnen, procedures en uitvoeringsmaatregelen.

- •

De directie zorgt dat de eindverantwoordelijke portefeuillehouders binnen het college gevraagd en ongevraagd geïnformeerd worden over de mate en wijze waarop AI wordt ingezet. Op die manier kan het college zich ook verantwoorden naar de raad.

Teammanagers

De teammanagers zijn eindverantwoordelijk voor de naleving van de AI-wetgeving binnen het team, alsmede voor de uitvoering van het AI-beleid. Alle AI-toepassingen hebben minimaal 1 eigenaar; er is altijd 1 iemand verantwoordelijk.

De teammanagers hebben de volgende rollen en verantwoordelijkheden:

- •

Eindverantwoordelijk voor het gebruik van AI binnen het eigen team.

- •

Verantwoordelijk voor implementatie en uitvoering van het AI-beleid binnen het eigen team.

- •

Informeert de toezichthouder op welke manier het eigen team compliant is.

- •

Verantwoordelijk voor het laten volgen van trainingen door werknemers binnen het eigen team.

- •

Rapporteert aan de directie over de door hen ingezette AI-toepassingen.

- •

Verantwoordelijk voor het (met ondersteuning van de AI-officer) registreren van de AI-toepassing(en) in het Algoritmeregister voor zover dit betrekking heeft op het eigen team.

- •

Betrekt het expertiseteam AI en de AI Officer (zie verderop) in een vroeg stadium bij nieuwe, gewenste of gewijzigde toepassingen van AI.

- •

Het (laten) uitvoeren van risicoanalyses en mogelijke (pre-)DPIA’s/IAMA’s op de AI- toepassingen waar hij/zij verantwoordelijk voor is.

Medewerkers

Medewerkers die AI willen inzetten, dienen op de hoogte te zijn van het kader, AI-geletterd te zijn en zich, bij het overwegen van AI-inzet, altijd te wenden tot de AI Officer en het expertiseteam AI.

Expertiseteam AI

Het expertiseteam AI wordt gevormd door experts vanuit verschillende disciplines. De kern bestaat uit een data-sciëntist, AI Officer, I&A-adviseur, Privacy Officer (inhoudelijk adviserend m.b.t. privacywetgeving), een collega die de ethische aspecten van de AI beoordeeld en een beleidsadviseur duurzaamheid. De vorm van het expertiseteam en de werkwijze die wordt gehanteerd kan, afhankelijk van ontwikkelingen, bijgesteld worden. Het expertiseteam AI vormt de spil bij het beoordelen van de gewenste AI-toepassing. De Privacy Officer zorgt voor de link met de reeds functionerende DPIA-werkgroep indien er persoonsgegevens in de AI-toepassing worden verwerkt. De DPIA-werkgroep blijft bestaan naast het expertiseteam AI als het gaat om de verplichtingen uit de Avg en het uitvoeren van DPIA’s. Het expertiseteam AI is verantwoordelijk voor de uitgevoerde risicoanalyses voor de toepassingen van AI. Het kan voorkomen dat er verschillende risicoanalyses uitgevoerd moeten worden afhankelijk van de gewenste toepassingen.

Rollen en verantwoordelijkheden:

- •

Bepaalt (op basis van het kader uit de AI-act) om welke categorie AI het gaat (onaanvaardbaar, hoog, beperkt, transparantie-risico of minimaal).

- •

Voert naar aanleiding van bovengenoemde vaststelling een Impactassessment uit die nodig is en passend bij deze AI.

- •

Beslist over de verdere routering qua besluitvorming afhankelijk van de uitkomsten van de assessments. Draagt zorg voor de voorbereiding van deze besluitvorming.

- •

Legt de voorgenomen AI-toepassing, samen met het assessment en de beoordeling voor aan het hiervoor gekozen besluitvormende gremium (MT, Directie of College van B&W).

AI Officer

De AI Officer voert regie op de inzet van AI. De AI Officer is het eerste aanspreekpunt voor de gemeente rondom AI-gerelateerde vraagstukken en heeft een monitorende en ondersteunende functie rondom het naleven en uitvoeren van de AI-wetgeving en het AI-beleid. De AI Officer fungeert als de brug tussen technologie en menselijke waarden. De AI Officer zorgt ervoor dat AI-systemen ethische normen volgen en dat er transparantie is over hoe beslissingen worden genomen. De AI Officer is verantwoordelijk voor het bijhouden van ontwikkelingen en zorgt ervoor dat AI-toepassingen in overeenstemming zijn met de wet. De AI Officer heeft een breed scala aan vaardigheden, die zowel technisch, zakelijk als interpersoonlijk zijn. Hij of zij heeft een goed begrip van het huidige en toekomstige AI-landschap en is in staat om kwesties rond het ethisch gebruik van AI en de uitdagingen rond bias, privacy en de impact van AI te begrijpen.

De AI Officer heeft de volgende rollen en verantwoordelijkheden:

- •

Informatie ophalen binnen de organisatie, overzicht te creëren op al het algoritme- en AI- gebruik dat plaatsvindt en dat overzicht goed bij te houden.

- •

Coördineren van het expertiseteam AI zodat gezamenlijke visie op het algoritmegebruik binnen de organisatie ontstaat.

- •

Een dergelijke visie te vertalen naar een heldere richtlijnen en protocollen en voor de gehele organisatie.

- •

Monitort veranderingen in wetgeving en stelt de impact van deze wijzigingen vast en adviseert de organisatie bij de implementatie hiervan.

- •

Draagt AI-wetgeving en -beleid actief uit binnen de gehele gemeente en bevordert een cultuur van duurzame inzet van AI.

- •

Adviseert verwerkingsverantwoordelijken ten aanzien van het mitigeren van AI risico’s, bijvoorbeeld bij het uitvoeren van IAMA’s en hoog-risico AI.

- •

Beheert het centrale algoritmeregister en de koppeling met het landelijke Algoritmeregister.

- •

Monitoring en Evaluatie: verantwoordelijk voor (het bewerkstelligen van) voortdurende evaluatie om te waarborgen dat AI-systemen ethisch en effectief blijven werken. Dit kan door regelmatige audits, zowel intern als door externe partijen en het aanpassen van beleid waar nodig.

Toezichthouder

De rol van toezichthouder is belegd bij de Functionaris Gegevensbescherming. De toezichthoudende rol op de uitvoering van de AI Act ligt in Nederland bij de Autoriteit Persoonsgegevens20 en sluit zo aan bij de structuur die voor de Avg geldt. Dit wordt binnen de gemeente voortgezet door de Functionaris Gegevensbescherming toezicht te laten houden.

De toezichthouder heeft de volgende rollen en verantwoordelijkheden:

- •

Interne toezichthouder op de naleving van de AI Act en aanverwante wet- en regelgeving aangaande AI.

- •

Rapporteert jaarlijks aan het College van B&W.

Andere rollen en verantwoordelijkheden

De beoordeling door het expertiseteam AI kan of moet soms aangevuld worden door een beroep te doen op andere onderdelen van de gemeentelijke organisatie. Bij het inzetten van AI kunnen deze teams of werkzaamheden nodig zijn om de AI slim, veilig en verantwoord in te zetten.

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

6. Basis op orde

De volgende vier onderdelen vormen het fundament voor de uitwerking van het beleid.

6.1 Training en AI-geletterdheid

Artikel 3 sub 56 van de AI Act geeft de definitie van “AI-geletterdheid”: vaardigheden, kennis en begrip die aanbieders, gebruiksverantwoordelijken en betrokken personen, rekening houdend met hun respectieve rechten en plichten in het kader van deze verordening, in staat stellen geïnformeerd AI- systemen in te zetten en zich bewuster te worden van de kansen en risico’s van AI en de mogelijke schade die zij kan veroorzaken;

AI-geletterdheid omvat het vermogen om AI-systemen te begrijpen, te evalueren en ermee te werken. Het gaat verder dan alleen technische kennis; het omvat ook inzicht in de ethische, maatschappelijke en juridische implicaties van AI. Voor de publieke sector is AI-geletterdheid van cruciaal belang om:

- •

Effectief gebruik te maken van AI-technologieën voor betere dienstverlening;

- •

Risico’s en uitdagingen van AI-implementatie te identificeren en te beheersen;

- •

Te voldoen aan wet- en regelgeving, zoals de AI Act;

- •

Vertrouwen van burgers in AI-gedreven overheidsdiensten te waarborgen.

Door te investeren in de ontwikkeling van AI-kennis en -vaardigheden, voldoet de gemeente niet alleen aan de eisen van de AI Act, maar kunnen ook de voordelen van AI-technologie optimaal benut worden voor betere dienstverlening aan burgers. De sleutel tot succes ligt in een gestructureerde aanpak die technische kennis combineert met ethisch bewustzijn en kritisch denkvermogen. Door AI- geletterdheid te verankeren in de organisatiecultuur, kan slim, veilig en verantwoord effectief gebruik gemaakt worden van AI. De tijdlijn van de AI Act geeft februari 2025 aan als moment voor het voldoen aan de norm AI-geletterdheid.21

6.2 Risicoanalyse

Als wordt overwogen om AI in te gaan zetten of als er vanuit een al gecontracteerde leverancier AI gepusht wordt, dan dient er een risicoanalyse gedaan te worden om de route te bepalen van wat er moet gebeuren. Door het uitvoeren van de analyse wordt bepaald in welke risico-categorie de AI valt en dan kan vervolgens worden bepaald wat er nodig is om deze AI mogelijk in te zetten. De risicoanalyse wordt aangevraagd bij de AI officer die tevens het eindoordeel velt. De AI officer bepaalt zelf wie er mogelijk betrokken worden bij deze beoordeling. Het format voor de risicoanalyse wordt vastgesteld door de Directie.

6.2.1 Impactassessments

AI kan worden ingezet om handelingen sneller of efficiënter uit te voeren. AI biedt kansen, maar het brengt ook gevaren en/of risico’s met zich mee. Daarom zijn er de Impactassessments. Hiermee kan vooraf goed worden uitgezocht welke kansen de inzet van AI biedt en kun je ook zien wat de mogelijke gevolgen zijn en welke mogelijke maatregelen ingeregeld moeten of kunnen worden en wie waarvoor verantwoordelijk is.

De gemeente Súdwest-Fryslân werkt met 2 Impactassessments:

- 1.

Conformity assessment / conformiteitsbeoordeling

Aanbieders moeten (op basis van art. 43 AI Act) een conformiteitsbeoordeling uitvoeren op een AI- systeem met hoog risico voordat het op de markt mag worden gebracht. Bij de

conformiteitsbeoordeling moet worden nagegaan of aan de vereisten van de AI Act is voldaan d.m.v. een self-assessment of een assessment door een derde partij.

- 2.

Fundamental Rights Impact Assessments (FRIA/IAMA)

Het doel van de IAMA uit art. 27 van de AI Act: het beoordelen van de gevolgen die het gebruik van de in te zetten AI kan hebben voor de grondrechten. Wanneer wordt gebruik gemaakt van de IAMA? Voor een hoog risico-AI-systeem dat de gemeente wil inkopen of maken of gebruiken, moet een IAMA worden uitgevoerd. Deze IAMA moet afgerond zijn voor het in gebruik nemen van een AI- systeem. De opdrachtgever/eigenaar is verantwoordelijk voor het (laten) uitvoeren hiervan. Bij het overwegen van de inzet van AI wendt de opdrachtgever/eigenaar zich direct tot de AI Officer.

De IAMA van de gemeente Súdwest-Fryslân is gebaseerd op het AI Impact Assessment (AIIA) model van de Rijksoverheid22 Een IAMA en het vaststellen van mogelijke risico’s23 vindt plaats om de volgende redenen:

- •

Bewustzijn creëren van de risico’s

- •

Focus op hoge / medium risico’s

- •

Het verdelen van middelen

- •

Mitigerende maatregelen implementeren

- •

Vaststellen gradatie van menselijke tussenkomst

- •

Beoordelen of de voordelen opwegen tegen de risico’s

- •

Mogelijke gevolgen van vastgestelde risico’s documenteren

-

6.3 Governance en nieuwe rollen

In hoofdstuk 5 is reeds de governance nodig voor het uitvoeren van het AI-beleid omschreven. Onder dit kopje worden de werkzaamheden die nog niet eerder zijn gedaan en die nog niet bestaan binnen de gemeente nog een keer kort toegelicht. Het betreft het Expertiseteam AI en de functie van AI Officer.

Expertiseteam AI:

Het expertiseteam AI is samengesteld uit vertegenwoordigers van verschillende geledingen en betrokkenen uit de organisatie. Het team heeft eigen bevoegdheden zoals vastgelegd in dit beleid en volgt trainingen en scholing om haar werkzaamheden uit te kunnen voeren.

De AI Officer:

De nieuwe functie en taken van de AI Officer moet worden vastgelegd en ingericht. Taken die onder andere bij de AI Officer belegd worden zijn:

Inventariseren welke AI-systemen en algoritmes er binnen de organisatie worden ontwikkeld

en/of gebruikt en classificeer deze systemen op grond van bijv. de risico-classificatie

van de AI Act.

6.4 Richtlijn ChatGPT, Copilot (van Microsoft), Google Bard of andere Large Language Models (LLM’s)

Vervolgens kunnen deze systemen/toepassingen in een register worden opgenomen. Daarnaast dient de AI Officer zorg te dragen voor het vullen van het nationale Algoritmeregister. Het aanleveren van informatie over algoritmes is nu nog niet verplicht voor overheidsorganisaties. Die verplichting komt er wel aan.

Begin 2023 is deze vorm van generatieve AI voor het eerst onder de aandacht gekomen binnen de gemeentelijke organisatie. Dit was vooral vanwege de opkomst van ChatGPT van ontwikkelaar OpenAI eind 2022. Er zijn voorlichtingen geweest over het gebruik van ChatGPT en er is een Richtlijn opgesteld waaraan men moet denken bij het gebruik van een ChatGPT (of een andere LLM). Zo zijn medewerkers er bijvoorbeeld op gewezen nooit persoonsgegevens of strategisch gevoelige informatie te delen met deze software, transparant te zijn over het gebruik ervan en altijd zelf de verantwoordelijkheid voor het resultaat te houden (zie bijlage 2). De Rijksoverheid hanteert vanaf december 2023 de richtlijn geen ongecontracteerde generatieve AI te gebruiken, waar ChatGPT vanwege diens voorwaarden onder valt. Bij de gemeente Súdwest-Fryslân is nog geen beleid hoe om te gaan met de mogelijke LLM’s. Beleid hiervoor zal separaat van dit AI-beleid in een nieuwe Richtlijn tot stand komen. De AI Act schrijft voor dat per augustus 2025 de regels voor AI-modellen voor algemene doeleinden ingaan, de LLM’s vallen hieronder.

7. Slotbepalingen

- 1.

Deze beleidsregels treden de dag na publicatie in het Gemeenteblad in werking.

- 2.

Deze beleidsregels worden aangehaald als: Artificiële Intelligentie (AI) beleid gemeente Súdwest-Fryslân.

Ondertekening

Aldus vastgesteld in de vergadering van het college van 3 februari 2026

Mr. drs. J.A. de Vries, burgemeester

Drs. C. Smits, gemeentesecretaris

Bijlagen

Bijlage 1

Uit de Handreiking AI en Algoritmen van de VNG

(https://www.informatiebeveiligingsdienst.nl/product/handreiking-ai-en-algoritmen/)

Risico’s voor gemeenten

Het gebruik van AI brengt risico's met zich mee voor gemeenten. Om deze risico's te beheersen, is het essentieel dat gemeenten proactief handelen en passende maatregelen nemen. Hieronder volgt een overzicht van de enkele belangrijke risico’s en voorbeelden van maatregelen bij het gebruik AI:

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Bijlage 2

Richtlijnen gebruik ChatGPT, Google Bard, Copilot of andere LLM’s (Large language models)

Deze tools beloven veel: vragen beantwoorden, tekstvoorstellen of suggesties en aanpassingen waarmee je snel aan de slag kunt. De tool kent echter ook een aantal valkuilen waar we mee moeten leren omgaan. Met de volgende vuistregels is veilig gebruik mogelijk:

GPT en de anderen zijn een hulpmiddel

Controleer en bewerk ten allen tijden de uitvoer voordat je deze met collega's of derden deelt. Uiteindelijk blijf jij verantwoordelijk voor wat er met de uitvoer gebeurt.

GPT en de anderen zijn geen zoekmachine

Gebruik de LLM’s niet om feiten op te vragen of te controleren. LLM’s leveren je dingen die mooi klinken, ongeacht of ze kloppen. De bronnen zijn niet te checken en vaak onduidelijk.

GPT en de anderen kennen geen privacy

Noem geen persoonlijke informatie van jou of anderen in een vraag. Controleer altijd nog een keer extra de persoonlijke informatie die eruit komt en overweeg of die noodzakelijk is.

GPT en de anderen doet niet aan geheimhouding

Alles wat je invoert, gebruikt men bij deze bedrijven voor eigen doeleinden. Cijfers, namen, besluitvorming of (cruciale) processen, gevoelige informatie, stappenplannen of de strategie: dat hoort allemaal niet in deze programma’s.

GPT en de anderen doen niet aan controle

Controleer daarom zelf alle uitvoer op feitelijke onjuistheden of ongewenste/ongepaste uitspraken.

Gebruik je gezond verstand

Zou je dezelfde vragen ook aan een collega stellen? Of aan een leverancier of derde partij voorleggen? Zo niet, dan hoef je het ook niet te vragen aan deze LLM’s.

Gebruik een zakelijk account

Maak met je zakelijk mailadres een account aan, en gebruik dit ook alleen voor werkgerelateerde zaken. Verwijder geen conversaties; de chatgeschiedenis is belangrijk in het kader van het afleggen van verantwoording en mogelijk bewijs.

GPT en de anderen zijn redacteur

Gebruik de LLM’s voor het opzetten of structureren van teksten, of ter inspiratie bij het schrijven van eigen werk. Hele lappen tekst van de LLM’s letterlijk gebruiken is niet alleen saai, maar kan ook plagiaat opleveren.

GPT en de andere LLM’s gebruiken is niet duurzaam en gebruikt heel veel energie De servers waarop wordt gedraaid, verbruiken enorm veel energie (een gemiddeld antwoord kost een paar cent aan stroom). Neem dit mee in je afwegingen om een LLM te gebruiken.

Bijlage 3

Gebruikte bronnen:

https://open.overheid.nl/documenten/9b7b55fd-1762-499b-b089-2b7132c12402/file

https://www.informatiebeveiligingsdienst.nl/product/handreiking-ai-en-algoritmen/

https://www.autoriteitpersoonsgegevens.nl/themas/algoritmes-ai/ai-verordening

https://www.rijksoverheid.nl/documenten/rapporten/2024/01/01/overheidsbrede-visie-generatieve-ai

https://vng.nl/brieven/principes-voor-de-digitale-samenleving

https://www.autoriteitpersoonsgegevens.nl/actueel/ap-onstuimige-opkomst-ai-vraagt-om-waakzaamheid-van-iedereen

https://algoritmes.overheid.nl/nl

https://algoritmes.pleio.nl/wiki/view/19bb6e9e-7a97-43d5-bef3-b1d66e59f4ff/handreiking-algoritmeregister

https://www.rekenkamer.nl/publicaties/rapporten/2024/10/16/focus-op-ai-bij-de-rijksoverheid

https://www.rekenkamer.nl/publicaties/brieven/2024/10/16/reactie-staatssecretaris-van-bzk-op-het-rapport-focus-op-ai-bij-de-rijksoverheid

https://www.amsterdam.nl/innovatie/amsterdamse-visie-ai/

Algemene Rekenkamer: Toetsingskader algoritmes v2.0

https://www.government.nl/documents/reports/2022/03/31/impact-assessment-fundamental-rights-and-algorithms

https://gemeente.groningen.nl/file/waar-moet-de-gemeente-op-letten-bij-het-inzetten-van-generatieve-ai

https://vng.nl/nieuws/position-paper-en-trendanalyse-ai-algoritmen-en-gemeenten

https://www.autoriteitpersoonsgegevens.nl/documenten/rapportage-ai-algoritmerisicos-nederland-ran-februari-2025

Bijlage 4 Definities

Algoritme: Een set van regels en instructies die een computer geautomatiseerd volgt bij het maken van berekeningen om een probleem op te lossen of een vraag te beantwoorden

AI (Artificial Intelligence, Artificiële Intelligentie, Kunstmatige Intelligentie): het nabootsen van menselijke vaardigheden met een computersysteem, zoals leren, plannen, redeneren, anticiperen en zelfstandig beslissen zonder tussenkomst van menselijke intelligentie.

AI-model: een softwarecomponent waarin kennis ligt besloten om op basis van invoer tot uitkomsten (zoals voorspellingen of classificaties) te komen. Modellen leren patronen uit voorbeeld data (voorbeeld invoer met een correcte uitkomst) en verwerken nieuwe invoer op basis hiervan tot een zo goed mogelijk uitkomst.

AI-systeem: een systeem dat is ontworpen om met verschillende niveaus van autonomie te werken en dat gebruikmaakt van een AI-model.

AI Act: De AI Act is een Europese verordening die regels stelt voor autonoom handelende computersystemen en algoritmes die beslissingen nemen, content genereren of mensen assisteren.

Generatieve AI: een vorm van AI die in staat is om nieuwe data te genereren. De meest populaire toepassingen maken teksten en afbeeldingen waar niet meer aan af is te zien dat deze door AI gegenereerd zijn. Een invoer van een gebruiker geeft vaak aan wat te genereren.

Machine learning: methodes om patronen uit data op te nemen in een AI-model.

Deep learning: een methode binnen machine learning. Deze methode maakt gebruikt van neurale netwerken met veel parameters.

Large Language Model (LLM): een AI-model dat op basis van veel tekstdata patronen heeft opgeslagen in grote neurale netwerken. Het model kan tekst genereren en kan bijvoorbeeld worden toegepast in vraag-antwoord-situaties.

Data Protection Impact Assessments (DPIA's): een DPIA is een instrument om vooraf de privacyrisico’s van een gegevensverwerking in kaart te brengen. Zodat de organisatie maatregelen kan nemen om deze risico’s te verkleinen.

Fundamental Rights Impact Assessment (FRIA’s/IAMA): met het Impact Assessment voor Mensenrechten bij de inzet van Algoritmes (IAMA) kan een afgewogen discussie gevoerd worden tussen de relevante partijen bij de afweging om wel of niet een algoritmische toepassing te gaan ontwikkelen. En het IAMA helpt om de gekozen ontwikkeling en implementatie vervolgens op een verantwoorde manier te doen.

Conformity assessment / conformiteitsbeoordeling: aanbieders moeten (op basis van art. 43 AI Act) een conformiteitsbeoordeling uitvoeren op een AI- systeem met hoog risico voordat het op de markt mag worden gebracht.

Samenvatting

Samenvatting Artificiële Intelligentie (AI) beleid Gemeente Súdwest-Fryslân

Het AI-beleid van de gemeente Súdwest-Fryslân biedt de kaders om de kansen van Artificiële Intelligentie slim, veilig en verantwoord te benutten. Het doel is om efficiëntie en innovatie te bevorderen, zonder concessies te doen aan de integriteit, het vertrouwen van de burger en onze maatschappelijke verantwoordelijkheden.

Kaders en Principes

Het beleid is verankerd in cruciale wettelijke kaders zoals de vanaf 1 oktober 2024 van kracht geworden Europese AI Act en de Algemene Verordening Gegevensbescherming en zorgt ervoor dat ook ethiek, mensenrechten en duurzaamheid worden meegenomen bij het gebruik van AI. De AI die wordt toegepast moet wettig, ethisch en robuust zijn.

De inzet van AI volgt daarom zeven leidende principes voortkomend uit de AI Act:

- 1.

Menselijke controle en menselijk toezicht

- 2.

Technische robuustheid en veiligheid

- 3.

Privacy en datagovernance

- 4.

Transparantie

- 5.

Diversiteit, non-discriminatie en rechtvaardigheid

- 6.

Maatschappelijk- en milieuwelzijn

- 7.

Verantwoording

Nieuwe Governance en Verantwoordelijkheden

Om het beleid te waarborgen én de 7 principes toe te passen, wordt de volgende governancestructuur ingericht, waarvoor het College van B&W eindverantwoordelijk is. Centraal hierin staan twee nieuwe rollen:

De AI Officer: Het eerste aanspreekpunt en de spil binnen de gemeente voor alle AI-gerelateerde vraagstukken en AI-toepassingen. De AI Officer coördineert, adviseert en monitort.

Het expertiseteam AI: Een multidisciplinair team dat risicoanalyses en impactassessments uitvoert en adviseert over de inzet van AI-toepassingen.

Praktische Verplichtingen voor de Organisatie

Voor de organisatie en haar medewerkers brengt dit concrete verplichtingen met zich mee, waaronder:

Er wordt geïnvesteerd in AI-geletterdheid om de basiskennis van kansen en risico's te vergroten.

Voordat een AI-systeem wordt ingezet, is een risicoanalyse verplicht.

Voor systemen met een hoog risico moet een Impact Assessment Mensenrechten en Algoritmes (IAMA) worden uitgevoerd.

Ter bevordering van de transparantie worden gebruikte algoritmes ingeschreven in het landelijke Algoritmeregister.

Richtlijn voor ChatGPT en andere LLM's

Voor het gebruik van Large Language Models (LLM's) zoals ChatGPT, Copilot of Bard geldt een duidelijke richtlijn: wees uiterst voorzichtig. Deel nooit persoonsgegevens of strategisch gevoelige informatie. Medewerkers blijven altijd zelf verantwoordelijk voor de output en moeten deze controleren op juistheid en feitelijkheid.

Noot

5https://nos.nl/nieuwsuur/artikel/2568297-nieuw-onderzoek-ai-verbruikt-11-tot-20-procent-van-wereldwijde-stroom-datacenters

Noot

6https://www.rijksoverheid.nl/documenten/rapporten/2024/01/01/overheidsbrede-visie-generatieve-ai

Noot

8AI Act: 's werelds eerste uitgebreide wetgeving over kunstmatige intelligentie. Het stelt regels op voor verantwoorde ontwikkeling en inzet van AI door bedrijven, overheidsinstanties en andere organisaties.

Noot

10https://www.rijksoverheid.nl/documenten/rapporten/2026/02/16/impact-assessment-mensenrechten-en-algoritmes

Noot

13https://www.rijksoverheid.nl/documenten/rapporten/2021/02/25/impact-assessment-mensenrechten-en- algoritmes

Noot

14https://www.autoriteitpersoonsgegevens.nl/themas/basis-avg/praktisch-avg/data-protection-impact- assessment-dpia

Noot

18https://www.rijksoverheid.nl/documenten/rapporten/2025/01/31/eindrapport-generatieve-ai-en-duurzaamheid en https://www.binnenlandsbestuur.nl/digitaal/ai-veroorzaakt-2027-stroomtekort-datacenters?tid=TIDP7585302XCE0A0AF0F6054ADEBB3F384B7C45C34FYI5&utm_campaign=BB_NB_Digit aal&utm_medium=email&utm_source=binnenlandsbestuur en https://www.binnenlandsbestuur.nl/digitaal/onderzoek-overheid-vergeet-ict-bij-klimaatdoelen

Noot

20https://www.autoriteitpersoonsgegevens.nl/documenten/rapportage-ai-algoritmerisicos-nederland-ran- februari-2025

Noot

21https://www.autoriteitpersoonsgegevens.nl/themas/algoritmes-ai/ai-verordening/ai-geletterdheid

Noot

22https://www.rijksoverheid.nl/documenten/rapporten/2026/02/16/impact-assessment-mensenrechten-en-algoritmes

Noot

23Mogelijke risico’s: hergebruik van persoonsgegevens (voor bijv. trainingsdoeleinden), beperkte transparantie en uitlegbaarheid, niet kunnen naleven van de privacyrechten (bijvoorbeeld: uitspraak Italiaanse toezichthouder over Chat GPT, DPIA SLM Rijk over Copilot), gelijkheidsrechten, recht op non-discriminatie, massasurveillance, gezichtsherkenningsalgoritmen, vrijheid van vergadering en protest, discriminatie van bevolkingsgroepen, reputatieschade, economische risico’s (bijv. kosten experts, omscholing), handelen op basis van foute output / hallucinaties, te veel vertrouwen op output van een systeem, desinformatie, deepfakes, veiligheid, duurzaamheid.

Ziet u een fout in deze regeling?

Bent u van mening dat de inhoud niet juist is? Neem dan contact op met de organisatie die de regelgeving heeft gepubliceerd. Deze organisatie is namelijk zelf verantwoordelijk voor de inhoud van de regelgeving. De naam van de organisatie ziet u bovenaan de regelgeving. De contactgegevens van de organisatie kunt u hier opzoeken: organisaties.overheid.nl.

Werkt de website of een link niet goed? Stuur dan een e-mail naar regelgeving@overheid.nl